姓名:Jyx

课程:csdn人工智能直通车-5期

描述:这是本人学习人工智能课程时的学习笔记,加深理解

分类问题同回归问题一样,也可以采用损失函数作为评价指标,

一、以损失函数作为评价指标

1.1 logistic/负log似然损失(log_loss):

−logloss=−1N∑i=1N∑j=1Myijlogpijyij={1,i≠j0,i=j,pij代表预测为i类实际为第j类的概率,N代表样本数,M代表类别数(2)

1.2 0-1损失

MCE=−1N∑yi^≠yi1

二、 混淆矩阵

针对分类问题特有的评价指标

2.1 混淆矩阵

| |

pred1

|

pred0

|

∑

|

|

real1

|

TP |

FN |

N+

|

|

real0

|

FP |

TN |

N−

|

|

∑

|

N^+

|

N^−

|

|

精度(accuracy):accuracy=TP+TNN

错误率(error rate):error rate=FP+FNN

PPV(positive predictive value)=TPTP+FN=TPN^+,预测结果为真的样本中真正为真的比例FDR(false discover rate)=FNTP+FN=1−PPVTPR=TPN+ ,预测为真的样本中真正为真的样本占真正为真的的样本的比例,又称为recallFPR=FPN− ,预测结果将多少假的样本预测成了真

一点分析:f1 socre 与FPR, TPR之间的关系,

假定Np代表样本中真正的正样本个数,Nn代表样本中真正的负样本个数PPV=TPTP+FP=NpTPRNpTPR+NnFPRf1 score=21PPV+1TPR=2NpTPRNp+NpTPR+FPRNn令α=NnNp,则f1 socre=2TPR1+TPR+αFPR

参考wiki

Positive and negative predictive values,

Sensitivity and specificity F1 score 是recall与precision的调和平均值,

即:

f1 score=21recall+1precision=21TPR+1PPV

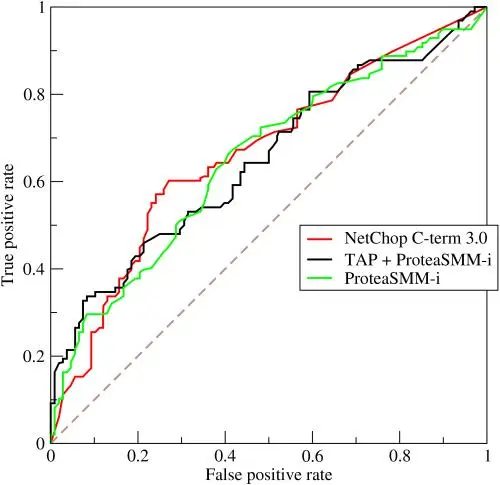

2.2 ROC, Receiver operating characteristic

对于某一特定的算法,在给定不同分类阈值的情况下得到一系列TPR,FPR,以FPR为横坐标,TPR为纵坐标绘图,得到的就是ROC曲线,曲线下的面积就是AUC,对于不同的算法,一般而言auc越高的算法性能越好

AUC=∫10TPRdFPR

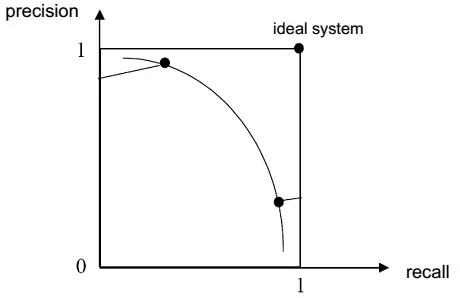

2.3 PR(Precision and recall) 曲线

负样本非常多,因此FPR=FP/N−总是很小,考察TPR和FPR不是很有意义,这是候我们就只讨论正样本,考察TPR(recall)和PPV(pricision).,

2.4 PR curve

PR 曲线信息检索中定义的一种曲线,并不适用于一般的分类问题。假定k为每次检索返回的信息条目数量,很显然,根据我们的定义recall将随k的增大而增大,precision将随k的增大而减小。在不同的k下得到一组recall,pricision值,绘制在同一坐标系中就是PR曲线。

AP(average pricision): PR曲线下的面积就是AP

MAP(mean average pricision): 对多次查询得到的AP进行平均就是MAP

[email protected]: 不计算全部,只计算pricision最高的前k个的AP

[email protected]多次查询[email protected]的平均值