一、概述

假设有以下数据:

D={(x1,y1),(x2,y2),⋯,(xN,yN)}xi∈Rp,yi∈R,i=1,2,⋯,NX=(x1,x1,⋯,xN)T=⎝⎜⎜⎜⎛x1Tx2T⋮xNT⎠⎟⎟⎟⎞=⎝⎜⎜⎜⎛x11x21⋮xN1x12x22⋮xN2⋯⋯⋱⋯x1px2p⋮xNp⎠⎟⎟⎟⎞N×pY=⎝⎜⎜⎜⎛y1y2⋮yN⎠⎟⎟⎟⎞N×1

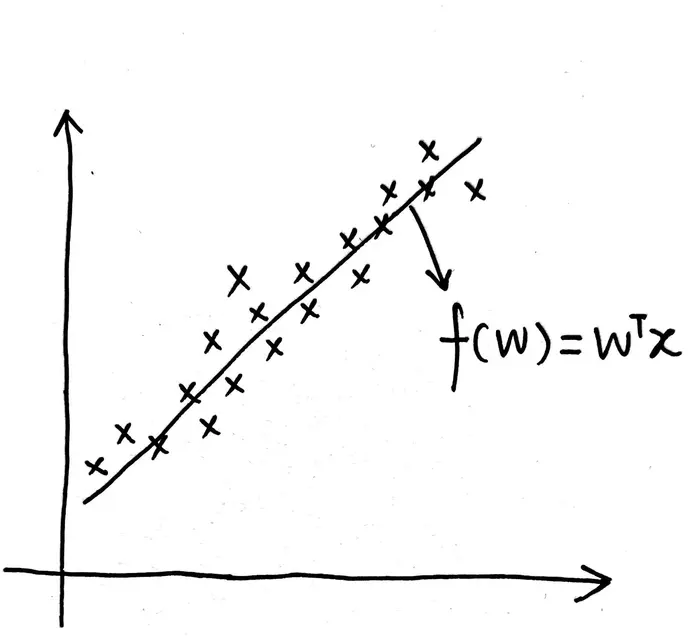

这些数据符合下图关系(以一维数据为例),这里的函数f(w)忽略了偏置b:

二、最小二乘估计

L(w)=i=1∑N∥∥wTxi−yi∥∥22=i=1∑N(wTxi−yi)2=wTXT−YTwT(x1x2⋯xN)−(y1y2⋯yN)(wTx1wTx2⋯wTxN)−(y1y2⋯yN)(wTx1−y1wTx2−y2⋯wTxN−yN)⎝⎜⎜⎜⎛wTx1−y1wTx2−y2⋮wTxN−yN⎠⎟⎟⎟⎞=(wTXT−YT)(Xw−Y)=wTXTXw−wTXTY−YTXw+YTY=wTXTXw−2wTXTY+YTY

接下来通过对w求导就可以解得参数w:

w^=argminL(w)∂w∂L(w)=2XTXw−2XTY=0得出w=X+,伪逆(XTX)−1XTY

以上未考虑偏执b,如果考虑的话则可以为w添加一个维度,同时也为x添加一个维度并使得添加的维度的值为1,然后使用同样的求解方法即可。.

三、线性回归的几何解释

- 每个样本点的误差的总和

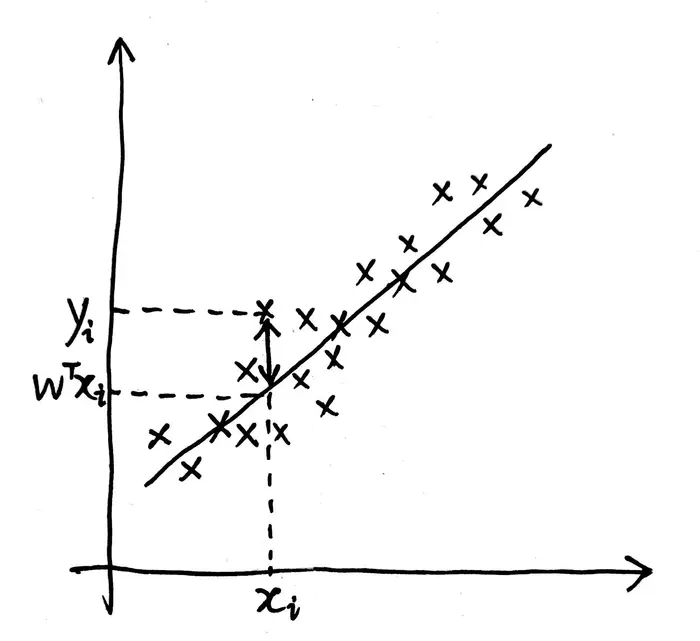

使用最小二乘法可以看做损失函数是每个样本的误差的总和,每个样本的误差即是yi与wTxi的差,如下图所示:

-

Y在X的列空间上的投影

一组向量的生成子空间(span)是原始向量线性组合后所能抵达的点的集合。确定方程Ax=b是否有解,相当于确定向量b是否在A列向量的生成子空间中。这个特殊的生成子空间被称为A的列空间(column space)或者A的值域(range)。

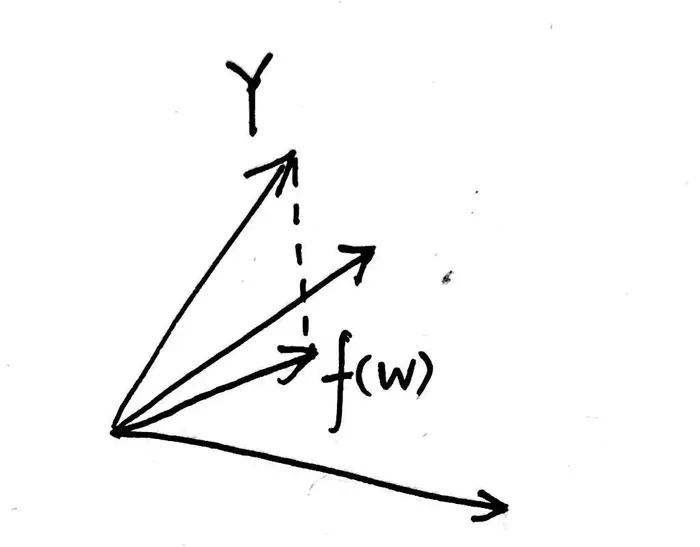

我们的目的是为了求解w使得Xw=Y,显然这个方程一般是无解的,即Y一般不在X的列空间中,因为样本点一般是散落在某条直线周围,所有的样本点准确地落在同一条直线上的情况少之又少。

对于Xw=f(w),为了使f(w)与Y最接近,则f(w)就应该是Y在X的列空间中的投影,如下图所示,以p=2为例:

Y−Xw就应该与每一个⎝⎜⎜⎜⎛x1ix2i⋮xNi⎠⎟⎟⎟⎞都垂直,即XT(Y−Xw)=0p×1,则可以直接解得w=(XTX)−1XTY。

四、最小二乘法与极大似然估计

可以认为实际值与估计值之间的差是一个高斯噪声,即y和f(w)满足关系$y=f(w)+\varepsilon =w^{T}x+\varepsilon ,其中\varepsilon是高斯噪声,满足\varepsilon\sim N(0,\sigma ^{2}),因此y|x;w\sim N(w^{T}x,\sigma ^{2}),即P(y|x;w)=\frac{1}{\sqrt{2\pi }\sigma }exp\left {-\frac{(y-w{T}x){2}}{2\sigma ^{2}}\right }$可以使用极大似然估计法来进行求解:

L(w)=logP(Y∣X;w)=logi=1∏NP(yi∣xi;w)=i=1∑NlogP(yi∣xi;w)=i=1∑N(log2π1+logexp{−2σ2(yi−wTxi)2})=i=1∑N(log2π1−2σ2(yi−wTxi)2)w^=wargmaxL(w)=wargmaxi=1∑N(log2π1−2σ2(yi−wTxi)2)=wargmaxi=1∑N−2σ2(yi−wTxi)2=wargmini=1∑N(yi−wTxi)2=wargmini=1∑N∥∥wTxi−yi∥∥22(最小二乘法)

可以看到最小二乘法与噪声为高斯噪声时的极大似然估计法是等价的。

五、线性回归的正则化

- 高维小样本的问题

w^=(XTX)−1XTY

当样本数N远大于维度p时XTX可逆,而当出现高维小样本的情况即维度p大于样本数N时,XTX就不可逆,这种时候就容易出现过拟合的情况。

- 处理过拟合的方法

面对上述过拟合的现象有一些解决方案,主要有⎩⎨⎧增加数据量特征选择/特征提取正则化

特征选择指的是根据某种规则去掉一些特征来实现降维;特征提取的方法例如主成分分析(PCA),也是实现降维;正则化的方法指给损失函数添加惩罚项来避免过拟合。

- 正则化的方法

通过最小化J(w)=lossL(w)+λpenaltyP(w)来实现正则化,主要有L1正则化和L2正则化(也叫岭回归、权重衰减)。

{L1正则化(Lasso):P(w)=∥w∥1L2正则化(Ridge):P(w)=∥w∥22

下面为L2正则化的求解过程:

J(w)=L(w)+λP(w)=(wTXT−YT)(Xw−Y)+λwTw=wTXTXw−2wTXTY+YTY+λwTw=wT(XTX+λI)w−2wTXTY+YTYw^=wargminJ(w)∂w∂J(w)=2(XTX+λI)w−2XTY=0w^=(XTX+λI)−1XTY

半正定矩阵XTX加上对角矩阵λI一定是可逆的,可以解决XTX可能不可逆带来的问题。

六、最小二乘法与最大后验估计

- 已知

仍然认为实际值与估计值之间的差是一个高斯噪声,即y和f(w)满足关系:

y=f(w)+ε=wTx+ε其中ε是高斯噪声,满足ε∼N(0,σ2)因此y∣x;w∼N(wTx,σ2),即P(y∣x;w)=2πσ1exp{−2σ2(y−wTx)2}

另外假设参数w的服从先验分布:

w∼N(0,σ02),即P(w)=2πσ01exp{−2σ02∥w∥22}后验概率为P(w∣Y)=P(Y)P(Y∣w)P(w)(这里的Y指Y∣X,为书写简单而省略。)

- 最大后验估计法求解参数w

w^=wargmaxP(w∣Y)=wargmaxP(Y)P(Y∣w)P(w)=wargmaxP(Y∣w)P(w)=wargmaxlogP(Y∣w)P(w)=wargmaxlogi=1∏NP(yi∣w)P(w)=wargmaxi=1∑NlogP(yi∣w)P(w)=wargmaxi=1∑Nlog(2πσ12πσ01exp{−2σ2(y−wTx)2−2σ02∥w∥22})=wargmaxi=1∑N(log2πσ12πσ01+logexp{−2σ2(y−wTx)2−2σ02∥w∥22})=wargmaxi=1∑N(−2σ2(y−wTx)2−2σ02∥w∥22)=wargmini=1∑N(2σ2(y−wTx)2+2σ02∥w∥22)=wargmini=1∑N(LSE(y−wTx)2+λσ02σ2∥w∥22)

可以看到正则化的最小二乘法与噪声为高斯噪声且先验也是高斯分布时的最大后验估计法是等价的。

- 总结

LSE⇔MLE(noise为GaussianDistribution)RegularizedLSE⇔MAP(noise、prior为GaussianDistribution)