分类:

Linux学习 Hadoop 2011-04-21 13:22169人阅读

评论(0)

收藏举报

转自:http://www.cnblogs.com/ventlam/archive/2010/11/24/hadoop.html

关于Hbase的介绍,可以参见http://wiki.apache.org/hadoop/Hbase与http://en.wikipedia.org/wiki/HBase。本文主要介绍在Ubuntu10.04环境下安装配置单机版原生的HBase。在网络上找到的文章要么语焉不详,要么ungeliable.于是记录一下自己的安装配置过程,做个STEP

BY STEP的图文并茂的教程,谨防自己以后忘记 。

安装Hbase其实主要是配置好java环境以及Hadoop与Hbase的配置文件。

1.安装并配置Java环境。在Ubuntu10.04默认的源使用的OpenJDK,在某些应用上OpenJDK并不被支持(如abicloud等).我们为了省事还是安装sun java ,打开终端,输入以下命令:

(1)安装

3 |

sudo apt-get install sun-java6-jre sun-java6-plugin sun-java6-fonts |

4 |

sudo apt-get install sun-java6-jdk sun-java6-plugin sun-java6-fonts |

查看是否安装成功

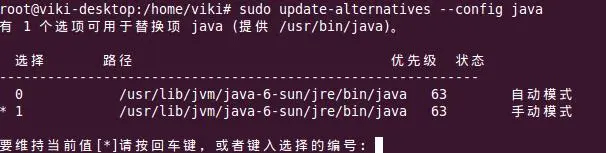

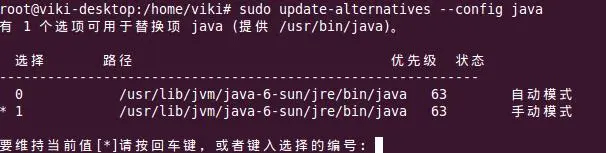

(2) 设置默认的java解释器。

1 |

sudo update-alternatives --config java |

会出现下列图面:

输入你想选择的编号。

(3)编辑java环境变量

1 |

sudo gedit /etc/environment |

在弹出的environment文件中添加下列两行:

CLASSPATH=.:/usr/lib/jvm/java-6-sun/lib JAVA_HOME=/usr/lib/jvm/java-6-sun

保存退出,行文至此,java环境已经配置好。

2.安装并配置Hadoop。虽说我安装的是单机版的Hbase,但是由于Hadoop本来就是分布系统,使用SSH通讯。

(1)安装ssh

1 |

sudo apt-get install ssh |

(2)设置不用登录密码

1 |

<PRE class=wiki>$ ssh-****** -t rsa -f ~/.ssh/id_rsa -P""</PRE>

|

2 |

<PRE class=wiki>$ cp ~/.ssh/id_rsa.pub ~/.ssh/authorized_keys</PRE>

|

完成后登录不用输入密码,第一次需要输入回车键。

(3)下载解压Hadoop,到http://hadoop.apache.org/common/releases.html#Download下载stable版本0.20.2.并解压到/Home路径

(4)修改hadoop-env.sh 。在本人机器上解压路径是/home/viki/hadoop-0.20.2,进入刚才所解压的文件夹,修改之(需要root权限)。

2 |

gedit conf/hadoop-env.sh

|

将以下java环境copy进去。

1 |

export JAVA_HOME=/usr/lib/jvm/java-6-sun-1.6.0.22

|

(5)设置xml文件,需要设置conf文件夹下的三个文件core-site.xml, hdfs-site.xml, mapred-site.xml。

1 |

gedit conf/core-site.xml |

将下面内容copy进该文件中:

03 |

<name>fs.default.name</name>

|

04 |

<value>hdfs://localhost:9000</value>

|

07 |

<name>hadoop.tmp.dir</name>

|

08 |

<value>/var/hadoop/hadoop-/${user.name}</value>

|

保存退出,继续修改另外一个文件hdfs-site.xml

1 |

gedit conf/hdfs-site.xml |

将下面内容copy进该文件

3 |

<name>dfs.replication</name>

|

保存退出,修改最后一个文件

将下面内容copy进该文件

3 |

<name>mapred.job.tracker</name>

|

4 |

<value>localhost:9001</value>

|

经历以上步骤,所有文件修改完毕,已经设置好Hadoop单机测试环境,下面将是启动Hadoop服务。

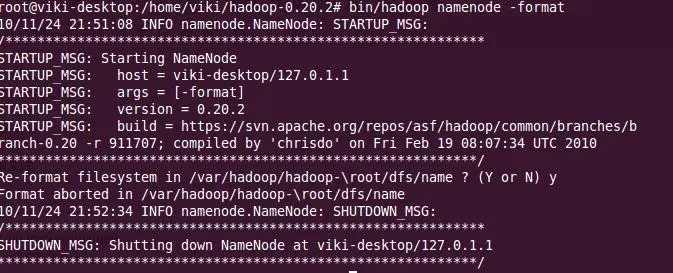

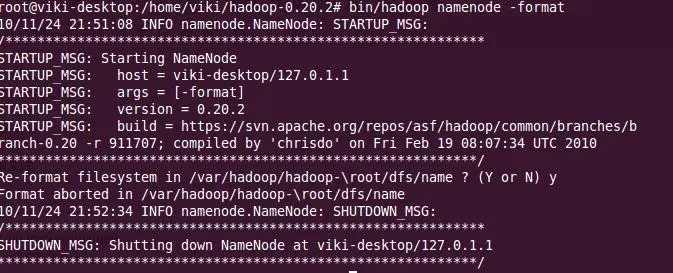

3.格式化Namenode并开启所有Hadoop服务,查看服务状态。

(1)格式化Namenode

1 |

bin/hadoop namenode -format |

会出现下面画面:

(2)启动所有Hadoop服务

会出现下面画面:

(3)查看服务状态。

管理页面:http://localhost:50030/jobtracker.jsp

转自:http://www.cnblogs.com/ventlam/archive/2010/11/24/hadoop.html

关于Hbase的介绍,可以参见http://wiki.apache.org/hadoop/Hbase与http://en.wikipedia.org/wiki/HBase。本文主要介绍在Ubuntu10.04环境下安装配置单机版原生的HBase。在网络上找到的文章要么语焉不详,要么ungeliable.于是记录一下自己的安装配置过程,做个STEP

BY STEP的图文并茂的教程,谨防自己以后忘记 。

安装Hbase其实主要是配置好java环境以及Hadoop与Hbase的配置文件。

1.安装并配置Java环境。在Ubuntu10.04默认的源使用的OpenJDK,在某些应用上OpenJDK并不被支持(如abicloud等).我们为了省事还是安装sun java ,打开终端,输入以下命令:

(1)安装

3 |

sudo apt-get install sun-java6-jre sun-java6-plugin sun-java6-fonts |

4 |

sudo apt-get install sun-java6-jdk sun-java6-plugin sun-java6-fonts |

查看是否安装成功

(2) 设置默认的java解释器。

1 |

sudo update-alternatives --config java |

会出现下列图面:

输入你想选择的编号。

(3)编辑java环境变量

1 |

sudo gedit /etc/environment |

在弹出的environment文件中添加下列两行:

CLASSPATH=.:/usr/lib/jvm/java-6-sun/lib JAVA_HOME=/usr/lib/jvm/java-6-sun

保存退出,行文至此,java环境已经配置好。

2.安装并配置Hadoop。虽说我安装的是单机版的Hbase,但是由于Hadoop本来就是分布系统,使用SSH通讯。

(1)安装ssh

1 |

sudo apt-get install ssh |

(2)设置不用登录密码

1 |

<PRE class=wiki>$ ssh-****** -t rsa -f ~/.ssh/id_rsa -P""</PRE>

|

2 |

<PRE class=wiki>$ cp ~/.ssh/id_rsa.pub ~/.ssh/authorized_keys</PRE>

|

完成后登录不用输入密码,第一次需要输入回车键。

(3)下载解压Hadoop,到http://hadoop.apache.org/common/releases.html#Download下载stable版本0.20.2.并解压到/Home路径

(4)修改hadoop-env.sh 。在本人机器上解压路径是/home/viki/hadoop-0.20.2,进入刚才所解压的文件夹,修改之(需要root权限)。

2 |

gedit conf/hadoop-env.sh

|

将以下java环境copy进去。

1 |

export JAVA_HOME=/usr/lib/jvm/java-6-sun-1.6.0.22

|

(5)设置xml文件,需要设置conf文件夹下的三个文件core-site.xml, hdfs-site.xml, mapred-site.xml。

1 |

gedit conf/core-site.xml |

将下面内容copy进该文件中:

03 |

<name>fs.default.name</name>

|

04 |

<value>hdfs://localhost:9000</value>

|

07 |

<name>hadoop.tmp.dir</name>

|

08 |

<value>/var/hadoop/hadoop-/${user.name}</value>

|

保存退出,继续修改另外一个文件hdfs-site.xml

1 |

gedit conf/hdfs-site.xml |

将下面内容copy进该文件

3 |

<name>dfs.replication</name>

|

保存退出,修改最后一个文件

将下面内容copy进该文件

3 |

<name>mapred.job.tracker</name>

|

4 |

<value>localhost:9001</value>

|

经历以上步骤,所有文件修改完毕,已经设置好Hadoop单机测试环境,下面将是启动Hadoop服务。

3.格式化Namenode并开启所有Hadoop服务,查看服务状态。

(1)格式化Namenode

1 |

bin/hadoop namenode -format |

会出现下面画面:

(2)启动所有Hadoop服务

会出现下面画面:

(3)查看服务状态。

管理页面:http://localhost:50030/jobtracker.jsp